Hơn một nghìn người, bao gồm các giáo sư và nhà phát triển trí tuệ nhân tạo (AI), đã cùng ký vào một bức thư ngỏ gửi tới tất cả các phòng thí nghiệm trí tuệ nhân tạo, kêu gọi họ tạm dừng phát triển và đào tạo các hệ thống AI mạnh hơn GPT-4 trong ít nhất sáu tháng.

Bức thư được ký bởi những người trong lĩnh vực công nghệ và phát triển AI, bao gồm Elon Musk, đồng sáng lập OpenAI, Yoshua Bengio, giáo sư AI nổi tiếng và người sáng lập Mila, Steve Wozniak, đồng sáng lập Apple, Emad Mostraque, CEO của Stability AI, Stuart Russell, người tiên phong trong lĩnh vực nghiên cứu AI, và Gary Marcus, người sáng lập Geometric Intelligence.

Bức thư được phát hành bởi tổ chức Future of Life, nêu ra những rủi ro tiềm ẩn đối với xã hội và nhân loại phát sinh từ sự phát triển nhanh chóng của các hệ thống AI tiên tiến trong khi không có các giao thức an toàn chung.

Vấn đề của cuộc cách mạng này là những rủi ro tiềm ẩn vẫn chưa được xác định và đánh giá đầy đủ bởi một hệ thống quản lý toàn diện.

Bức thư cảnh báo rằng các hệ thống AI hiện đại đang cạnh tranh trực tiếp với con người trong các công việc chung, điều này đặt ra một số câu hỏi về vấn đề tồn tại (existential) và đạo đức mà nhân loại vẫn cần xem xét, tranh luận và quyết định.

Một số câu hỏi đáng chú ý liên quan đến luồng thông tin do AI tạo ra, quá trình tự động hóa công việc không được kiểm soát, sự phát triển của các hệ thống thông minh hơn con người và có nguy cơ khiến họ trở nên lỗi thời.

Các chuyên gia đồng ký kết tin rằng chúng ta đã đạt đến điểm mà chúng ta chỉ nên đào tạo các hệ thống AI tiên tiến hơn dưới sự giám sát chặt chẽ và sau khi đủ tự tin đảm bảo các rủi ro phát sinh từ việc triển khai các hệ thống này có thể kiểm soát được.

"Vì vậy, chúng tôi kêu gọi tất cả các phòng thí nghiệm AI ngay lập tức tạm dừng ít nhất 6 tháng việc đào tạo các hệ thống AI mạnh hơn GPT-4", thư ngỏ khuyến cáo.

"Việc tạm dừng này phải được công khai và có thể kiểm chứng. Nếu việc tạm dừng như vậy không thể được ban hành nhanh chóng, các chính phủ nên can thiệp và đưa ra lệnh cấm."

Trong thời gian tạm dừng này, các nhóm phát triển AI sẽ có cơ hội gặp nhau và thống nhất về việc thiết lập các giao thức an toàn, sau đó sẽ được sử dụng cho các cuộc kiểm tra tuân thủ do các chuyên gia độc lập, bên ngoài thực hiện.

Ngoài ra, các nhà hoạch định chính sách nên thực hiện các biện pháp bảo vệ như hệ thống thủy ấn (watermarking system) giúp phân biệt hiệu quả giữa nội dung xác thực và nội dung bịa đặt, cho phép quy trách nhiệm pháp lý đối với tác hại do dữ liệu do AI tạo ra và nghiên cứu do chính phủ tài trợ về các rủi ro của AI.

Bức thư không ủng hộ việc ngừng phát triển AI hoàn toàn; thay vào đó, nó nhấn mạnh những mối nguy hiểm liên quan đến sự cạnh tranh phổ biến giữa các nhà thiết kế AI nhằm giành lấy thị phần đang mở rộng nhanh chóng.

Nguồn: bleepingcomputer.com.

Tín nhiệm mạng | Nhóm thanh khoản token SafeMoon đã bị mất 8,9 triệu đô la sau khi một tin tặc khai thác chức năng hợp đồng thông minh mới được thiết kế để ‘thổi phồng giá’ của các token, cho phép người dùng bán SafeMoon với giá cao hơn nhiều.

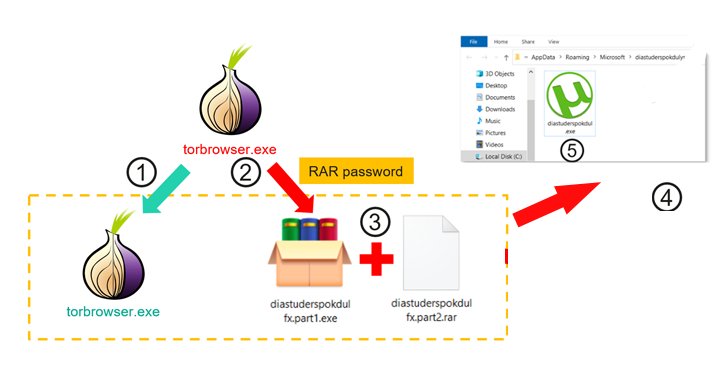

Tín nhiệm mạng | Các phiên bản trojan hóa của phần mềm cài đặt trình duyệt ẩn danh TOR đang được sử dụng để nhắm mục tiêu người dùng ở Nga và Đông Âu bằng mã độc clipper được thiết kế để đánh cắp tiền điện tử kể từ tháng 9 năm 2022

Tín nhiệm mạng | Conor Brian Fitzpatrick, người sáng lập 20 tuổi và quản trị viên của điễn đàn hack BreachForums, hiện không còn tồn tại, đã chính thức bị buộc tội tại Mỹ với âm mưu thực hiện hành vi gian lận thiết bị truy cập.

Tín nhiệm mạng | Apple đã phát hành bản cập nhật mới cho các bản vá được phát hành vào tháng trước để giải quyết lỗ hổng zero-day đã bị khai thác trong thực tế cho các máy iPhone và iPad cũ hơn.

Tín nhiệm mạng | Vào ngày thứ ba của cuộc thi hack Pwn2Own, các nhà nghiên cứu bảo mật đã giành được 185.000 đô tiền thưởng sau khi thử nghiệm thành công 5 khai thác zero-day nhắm vào Windows 11, Ubuntu Desktop và phần mềm ảo hóa VMware Workstation.

Tín nhiệm mạng | Phần mềm trojan giả dạng tiện ích bổ sung ChatGPT hợp pháp dành cho Chrome đã được đưa lên Cửa hàng Chrome trực tuyến (Chrome Web Store) và có hơn 9.000 lượt tải xuống.